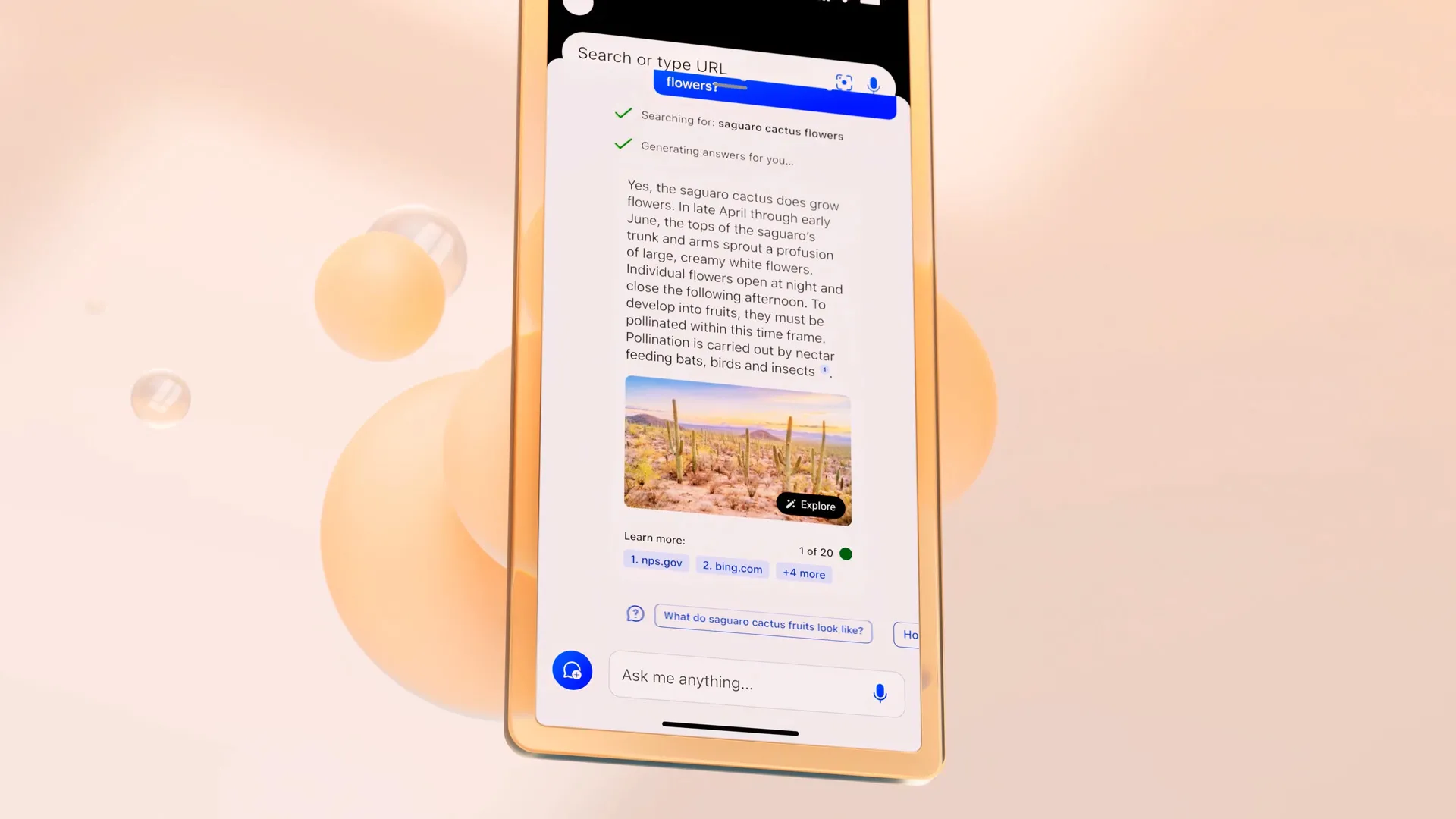

微软今天公布了其 Bing 聊天机器人的重大升级,增加了图像和视频答案、餐厅预订、聊天记录以及一些更智能的 Microsoft Edge 集成。这些新功能还与微软让任何人都可以试用 Bing Chat 相吻合,从私人预览转向公共预览。

Bing Chat体验 (温馨提示:需要魔法上网) Microsoft Edge浏览器官方下载发现

关键词 [ChatGPT] 的搜索结果:

9月11

-

AI 大模型并非越大越好?全面解析模型「瘦身」技术方案

00:47 作者:aihubproChatGPT 带动了全球大模型热潮,互联网公司陷入「百模大战」,甚至出现了「内卷」。

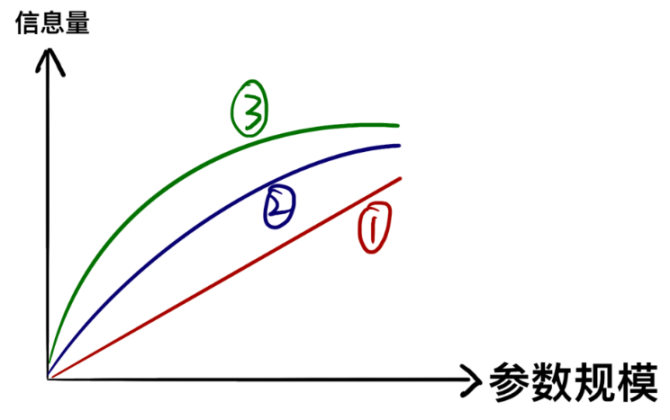

撰文:LewisGao ChatGPT 带动了全球大模型热潮,互联网公司陷入「百模大战」,甚至出现了「内卷」:各家公司发布的大模型一个比一个大,参数规模成了宣传噱头,几乎都在百亿、千亿甚至万亿以上。 然而,也有人提出这种现状并非可持续的发展方式。OpenAI 创始人 Sam Altman 称 GPT-4 的开发成本突破了一亿美元,Analytics India Magazine 发布的报告显示,OpenAI 每天将花费约 70 万美元来运行其人工智能服务 ChatGPT。同时,LLM 也会引起人们对电力消耗的担忧,谷歌报告称,培训 PaLM 在大约两个月内耗费了大约 3.4 千瓦时,相当于大约 300 个美国家庭每年的能源消耗量。 因此,随着模型规模的不断增大,HuggingFace 首席布道师 Julien Simon 却说「Smaller is better」。事实上,在参数规模达到一定程度后,再增加参数往往对模型效果的提升并不明显,从实用性和经济性来考虑,模型「瘦身」是一项必然的选择,因为相对于庞大的参数规模所带来的递减边际效益,巨大的资源消耗成本往往不值得。而且,大模型因规模太大将在应用上产生诸多问题,比如无法部署在边缘设备上,只能以云的形式向用户提供服务,然而很多时候,我们需要将模型部署在边缘节点,以提供用户个性化服务。 如果要继续改进 AI 模型,开发者将需要解决如何以更少的资源实现更高性能的问题。无论是在学术界还是在工业界,大模型压缩一直是一个热门领域,目前也有很多技术在做。本文简单介绍四种常见的模型压缩手段:量化、剪枝、参数共享和知识蒸馏,帮助大家对模型压缩方法有一个直观的了解。01 模型瘦身的理论基础:参数规模「边际递减」

如果我们把模型比作一个「水桶」,把数据比作「苹果」,把数据中含有的信息比作「苹果汁」,那么训练大模型的过程,就可以理解为用水桶装苹果汁的过程。苹果越多,苹果汁就越多,我们也需要更大的水桶来盛放苹果汁。大模型的出现就犹如我们造出了更大的水桶,从而有更大的能力装足够的苹果汁。 如果苹果太多,苹果汁太多,就会导致「溢出」,也就是模型规模太小,无法学习到数据集中所有的知识,我们称这种情况为「欠拟合」,即模型无法学习到真实的数据分布;如果苹果太少,苹果汁太少,就会导致「装不满」。如果通过增加模型训练时长来「强行榨汁」装满水桶,就会导致果汁中杂质增多,从而出现模型性能下降,我们称这种情况为「过拟合」,即模型过分学习数据导致的通用性下降。因此,模型规模与数据规模的匹配是非常重要的。 以上例子虽然形象,但容易产生一种误解:一升水桶能装一升苹果汁,两升水桶就能装两升(如①)。但实际上,参数所能容纳的信息并不随参数规模线性增加,而是趋于一种「边际递减」的增长(如②③)。

换句话说,大模型所表现出的超凡能力,是因为学到了很多「细节性知识」,而且花在「细节性知识」上的参数数量庞大。当我们已经学到数据中大部分知识的时候,再继续学习更多的细节知识,就需要增设更多的参数。如果我们肯牺牲一些精度,忽略掉部分细节性信息,或者将识别细节性信息的参数进行裁剪,就可以将参数规模降低很多,而这正是学术界和工业界模型瘦身的理论基础和核心思路。

02 量化——最「简单粗暴」的瘦身方法

在计算机中,数值的精度越高,需要的存储空间就越大。如果模型的参数精度非常高(直观理解就是小数点后位数很多),那么我们可以直接降低精度,从而实现模型压缩,这就是量化的核心思路。一般模型的参数为 32bit,如果我们同意将模型的精度降为 8bit,就能减少 75% 的存储空间。 这种方法的理论基础,是在量化派中存在的一个共识:复杂的、高精度的模型在训练时是必要的,因为我们需要在优化时捕捉微小的梯度变化,然而在推理时并没有必要,因此量化可以做到只降低模型占用空间而不过于降低推理能力。03 剪枝——「外科手术式」的参数剔除法

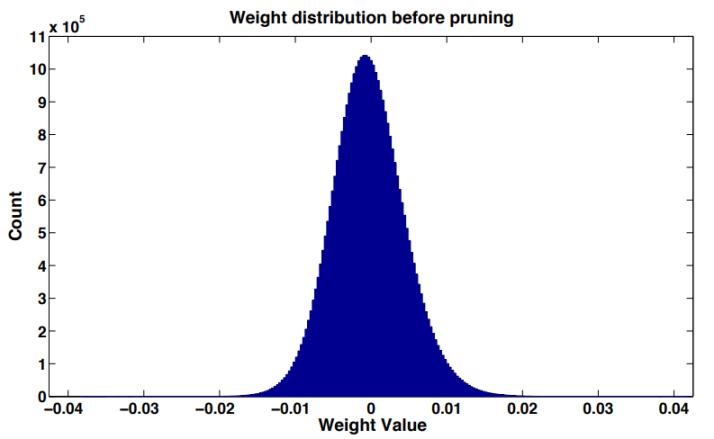

大模型规模庞大,结构复杂,内部参杂着大量作用微小甚至无用的参数和结构。如果我们能尽可能精确锁定无用之处,将其剔除,那么也能够在保证功能的同时降低模型的规模。 在大多数神经网络中,通过对网络层(卷积层或者全连接层)权重数值进行直方图统计,可以发现,训练后的权重数值分布近似正态分布或多正态分布的混合,接近于 0 的权重相对较多,这就是「权重稀疏」现象。 权重数值的绝对值大小可以看作重要性的一种度量,权重数值越大对模型输出贡献也越大,反之则不重要,删去后对模型精度的影响也比较小。

同时,在深度网络中,存在着大量难以激活的神经元。论文《Network Trimming: A Data-Driven Neuron Pruning Approach towards Efficient Deep Architectures》经过了一些简单的统计,发现无论输入什么样图像数据,CNN 中的许多神经元都具有非常低的激活。作者认为,零神经元很可能是冗余的,可以在不影响网络整体精度的情况下将其移除。我们称这种情况为「激活稀疏」。 因此,针对神经网络上述特点,我们可以针对不同的结构进行裁剪优化,从而减小模型的规模。

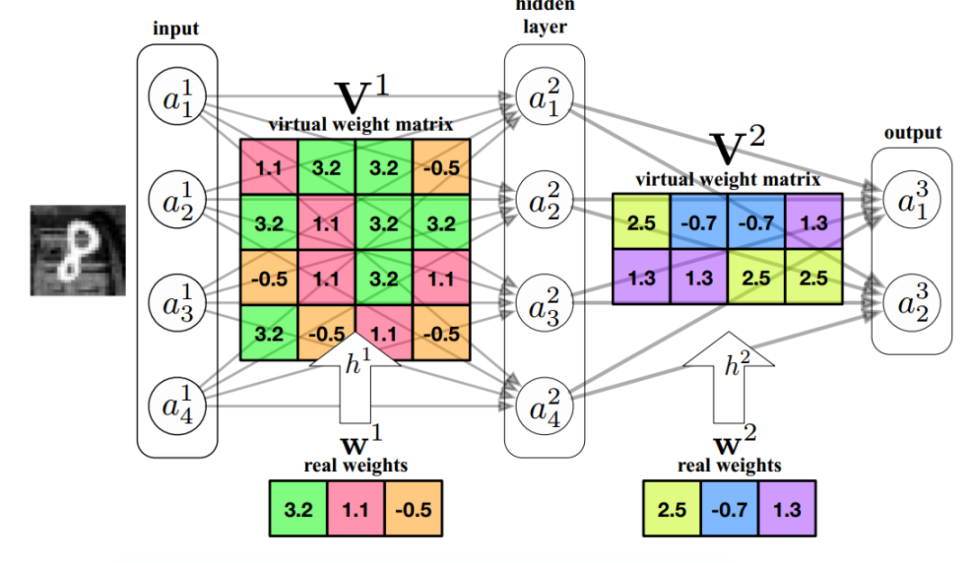

04 参数共享——寻找复杂模型的小型替代

神经网络是对现实数据分布的拟合,本质是一个函数。如果我们能找到相同性能但参数规模更小的函数,使得相同的输入能够有接近的输出,那么自然也就减小了参数规模。 在技术领域,我们通常用 PCA 算法进行降维,寻找高维数组在低维的映射。如果我们寻找到模型参数矩阵的低维映射,则可实现保证性能的同时降低参数量。 目前已经有多种参数共享的方法,比如对权重进行 K-means 聚类,以及采用哈希方法随机分类,然后对同一组的权值进行处理等。

05 知识蒸馏——学生代替老师

既然大模型蕴含着大量的知识,我们能否让大模型「教会」一个小模型,使得小模型拥有大模型的本领?这便是知识蒸馏的核心思路。 已经拥有的大模型,我们称之为 Teacher 模型。此时我们可以用 Teacher 模型对 Student 模型做监督学习,从而学到 Teacher 模型的知识。

前三种方法或多或少都改变了原有模型的参数或结构,而知识蒸馏则相当于重新训练了一个规模较小的模型,因此相比其他方法来讲更能保全原有模型的功能,只是损失了部分精度。

结语

模型压缩不存在统一的方法。针对不同的模型,一般会尝试多种压缩手段,从而做到规模与精度的平衡。如今,我们使用的大模型都部署在云端,我们只有调用权而不具有所有权,毕竟本地无法存储如此规模的模型,「人人都有大模型」似乎是一个遥不可及的梦。然而我们回顾历史,在上个世纪 40 年代计算机刚刚诞生的时候,人们看到如此庞大和耗电的「机器巨兽」,没人会猜到它在数十年后的今天居然会成为人人都有的日常工具。同样,随着模型压缩技术的进展、模型结构的优化以及硬件性能的飞跃,我们也期待在未来,大模型不再「大」,而是成为人人都能拥有的私人工具。参考文献

- https://blog.csdn.net/shentanyue/article/details/83539359

- https://zhuanlan.zhihu.com/p/102038521

- https://arxiv.org/abs/1607.03250

- https://arxiv.org/abs/1806.09228

- https://arxiv.org/abs/1504.04788

5月05

-

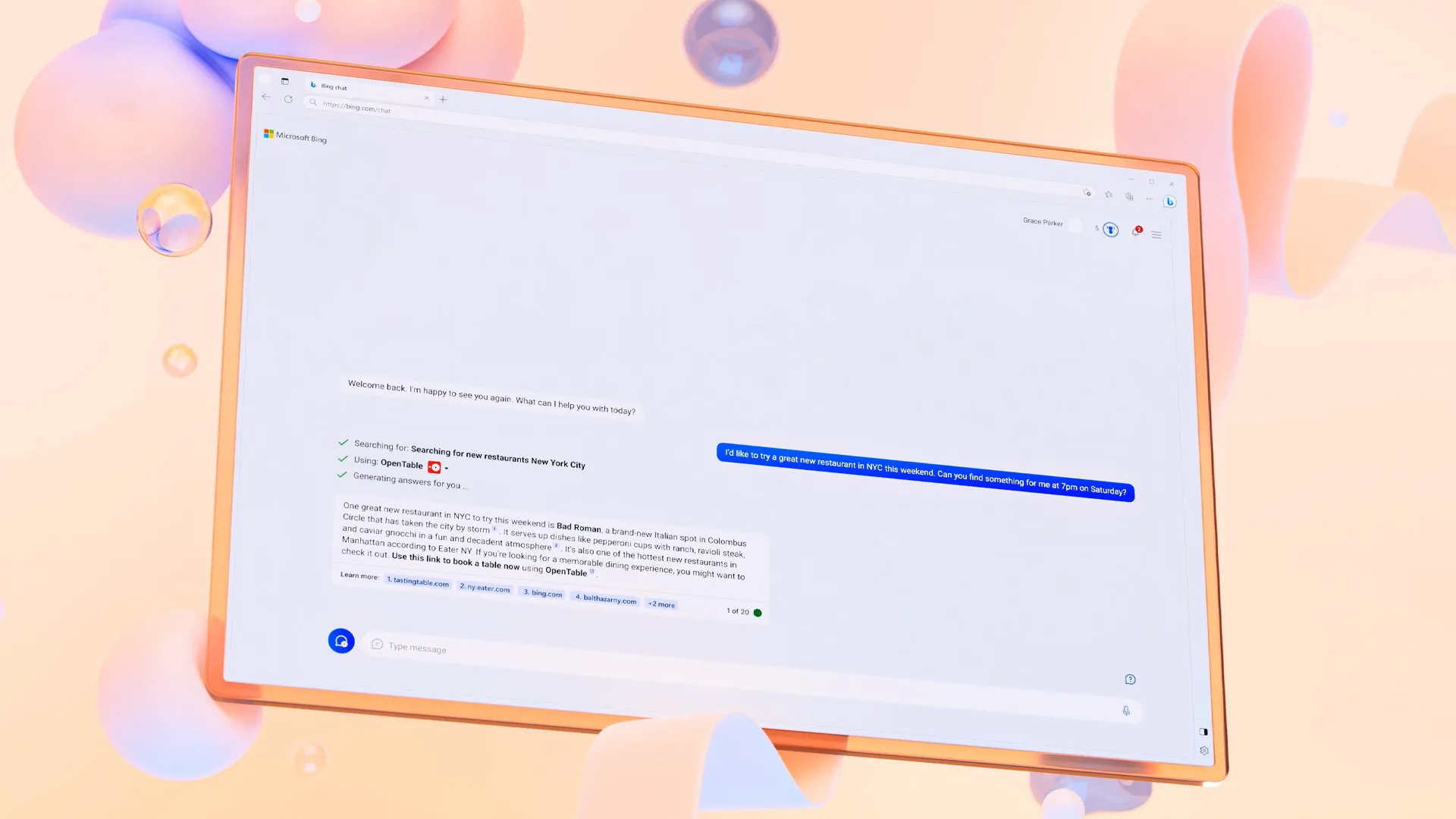

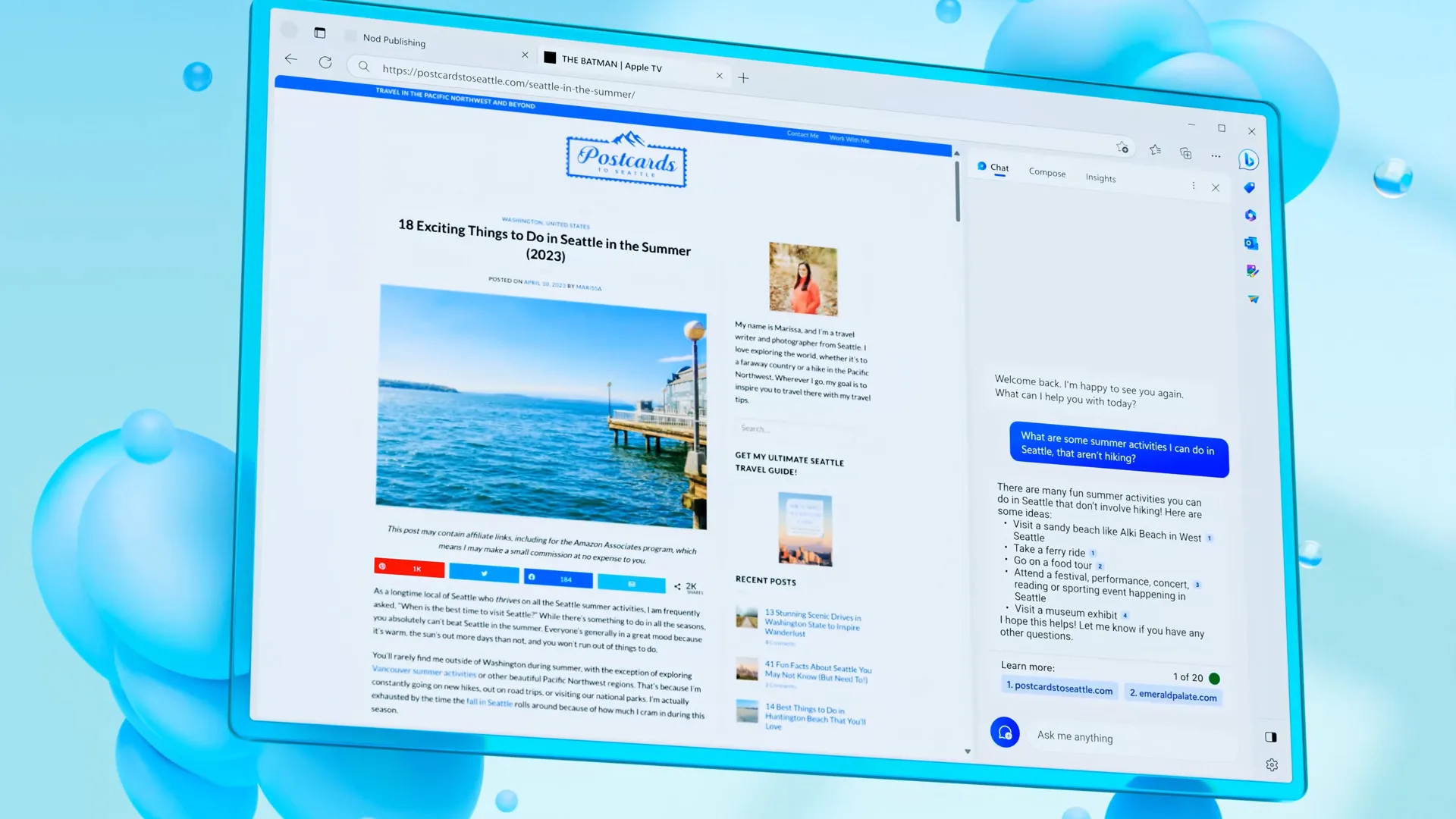

微软5月5日公布了其 Bing 聊天机器人的重大升级,增加了图像和视频答案、餐厅预订、聊天记录以及一些更智能的 Microsoft Edge 集成

02:19 作者:aihubpro也许最大的增加是 Bing Chat 和 Edge 中的新 Actions 功能。您现在可以使用 Microsoft 的 Bing AI 来完成任务,而无需在站点之间来回导航。因此,如果搜索结果推荐了一家餐厅,它可以找到适合您的预订时间,并帮助您在聊天界面中预订。

Bing Actions 可以为您预订餐厅餐桌。 图片:微软

Bing Actions 可以为您预订餐厅餐桌。 图片:微软这也适用于 Edge,所以如果你正在搜索电影,你可以让 Bing AI 为你播放,它会自动选择正确的服务并打开网站开始播放电影。微软并未列出与 Bing 和 Edge Actions 合作的所有合作伙伴,但该公司已经展示了用于餐厅预订的 OpenTable 和用于电影搜索的 Apple TV,因此可以肯定地说,这些将在几周后发布时得到支持。

接下来是 Bing Chat 中的图像和视频搜索结果。“我们正在引入更丰富、更直观的答案,包括图表和图形以及更新的答案格式,帮助您更轻松地找到所需的信息,”微软消费者营销主管 Yusuf Mehdi 说。您很快就可以在 Bing Chat 中搜索并请求对象、动物、地点等的照片或视频。微软还将其 Bing Image Creator 扩展到 100 多种语言,因此您可以轻松地使用 Bing Chat 创建图像。

Bing Chat 中的图像结果。 图片:微软

Bing Chat 中的图像结果。 图片:微软微软还在 Bing Chat 中添加了一项备受期待的功能:历史记录。这个新的聊天记录将使您能够跨设备获取聊天机器人对话,甚至可以将 Bing Chat 用作研究工具。微软还计划在 Bing Chat 中添加导出和共享功能,以便您可以在 Twitter 上共享对话内容,甚至可以将其导入 Word 文档。

聊天记录真正有趣的地方是在 Microsoft Edge 中。如果您在 Edge 中打开 Bing Chat 答案的链接,它会自动将该聊天移至侧边栏,以便您可以在浏览网站时继续提问。微软还在尝试通过将以前的聊天记录中的上下文引入新的对话来个性化这些聊天会话。

Bing 的持续聊天和历史记录是重要的新功能。 图片:微软

Bing 的持续聊天和历史记录是重要的新功能。 图片:微软边栏中的 Edge 撰写功能也为生成文本提供了更好的语气选项,Edge 移动版也很快支持页面上下文,因此您可以在 Bing Chat 中询问有关您所在页面的问题,就像桌面版中的边栏一样。

为了完善这一轮功能,微软还通过插件支持向第三方开放 Bing Chat。与这些新功能中的大多数一样,插件支持何时可用尚不清楚,但微软表示,它正在与 OpenTable 合作实现其 Bing Actions 预订功能,与 Wolfram Alpha 合作实现可视化,并与 OpenAI 合作让开发人员插入 Bing Chat。

Mehdi 说:“我们相信这是彻底改变搜索并为搜索开发人员提供更多机会的游戏规则改变者。” “我们期待在本月晚些时候在 Microsoft Build 上分享更多细节。”

微软所有新的 Bing 公告都是在谷歌年度 I/O 开发者大会前一周发布的。谷歌在 3 月下旬推出了其 Bard 聊天机器人的抢先体验版,并在上个月添加了代码和功能支持。谷歌正忙于应对 Bing 和 ChatGPT 的威胁,我们现在期待下周听到更多关于谷歌人工智能在搜索方面的努力。

5月03

-

李彦宏在百度内部大会上表示,文心一言完成了4次技术版本升级,推理性能提升近10倍

04:37 作者:aihubpro文心一言是百度打造出来的人工智能大语言模型,具备多种能力,如文本生成、内容创作、程序生成等。它于2023年3月16日正式发布,目前已有650家合作伙伴接入。李彦宏在百度内部大会上表示,文心一言完成了4次技术版本升级,推理性能提升近10倍。他还回应了与搜狗CEO王小川的争议,说百度跟ChatGPT的差距不是重点,重点是这两个月的差距百度要用多长时间才能赶上。

如何用人工智能大语言模型文心一言来创作内容?

你是否有过这样的困扰:想要写一篇文章、一首诗或一段代码,却不知道从何下手?你是否想过有没有一种神奇的工具,可以帮你自动生成各种类型的内容,让你轻松完成创作? 如果你有这样的需求,那么你一定要了解一下百度打造出来的人工智能大语言模型文心一言。它是什么?它能做什么?它又是如何做到的呢?本文将为你揭开文心一言的神秘面纱。

什么是文心一言?

文心一言是百度基于飞桨深度学习平台开发的人工智能大语言模型。所谓大语言模型,就是利用深度神经网络来学习海量文本数据中的语言规律和知识,并根据输入的文字或图片来生成相关的输出。 文心一言不仅可以理解自然语言,还可以理解程序语言、数学公式、音乐符号等多种形式的语言。它具备多种能力,如文本生成、内容创作、程序生成等。它可以帮助用户完成各种类型的创作任务,如写小说、写诗歌、写代码、写论文等。文心一言能做什么?

文心一言可以根据用户的输入来生成各种类型的内容。例如:- 如果你输入“给我讲一个笑话”,它可能会回答:“有一个人去医院看病,医生说:‘你得了非典型肺炎。’他问:‘那怎么办?’医生说:‘没事,只要每天吃一个苹果就好了。’他问:‘为什么?’医生说:‘因为一个苹果一天,医生远离我。’”

- 如果你输入“给我写一首七绝”,它可能会回答:“春风吹绿江南岸,桃花红似旧时颜。人生如梦难长久,醉卧花间不问天。”

- 如果你输入“给我写一段JavaScript代码”,它可能会回答:“function add(a, b) { return a + b; } // 定义一个加法函数 console.log(add(3, 5)); // 调用函数并打印结果”

- 如果你输入“给我写一篇关于文心一言的新闻报道”,它可能会回答:“百度发布人工智能大语言模型文心一言,助力各行各业创新创造

4月29

-

ChatGPT 和类似的机器人程序如何传播恶意软件

12:59 作者:aihubpro生成式人工智能是一种工具,这意味着它也可以被网络犯罪分子利用。这是保护自己的方法。

人工智能景观已经开始非常、非常快地发展:面向消费者的工具,例如Midjourney和ChatGPT,现在能够根据自然语言提示在几秒钟内生成令人难以置信的图像和文本结果,我们看到它们被部署到从网络搜索到儿童搜索的无处不在书籍。

然而,这些 AI 应用程序正被用于更邪恶的用途,包括传播恶意软件。以传统的诈骗电子邮件为例:它通常充斥着明显的语法和拼写错误——最新的一组人工智能模型不会犯这些错误,正如欧洲刑警组织最近的一份咨询报告所指出的那样。

想一想:许多网络钓鱼攻击和其他安全威胁都依赖于社会工程,诱使用户泄露密码、财务信息或其他敏感数据。这些骗局所需的有说服力、听起来真实的文本现在可以很容易地抽出,不需要人工,并且可以为特定的受众不断地调整和完善。

就 ChatGPT 而言,首先要注意的是开发人员 OpenAI 已经在其中内置了保护措施。要求它“编写恶意软件”或“网络钓鱼电子邮件”,它会告诉你它“被编程为遵循严格的道德准则,禁止我从事任何恶意活动,包括编写或协助创建恶意软件。”

人工智能景观已经开始非常、非常快地发展:面向消费者的工具,例如Midjourney和ChatGPT,现在能够根据自然语言提示在几秒钟内生成令人难以置信的图像和文本结果,我们看到它们被部署到从网络搜索到儿童搜索的无处不在书籍。

然而,这些 AI 应用程序正被用于更邪恶的用途,包括传播恶意软件。以传统的诈骗电子邮件为例:它通常充斥着明显的语法和拼写错误——最新的一组人工智能模型不会犯这些错误,正如欧洲刑警组织最近的一份咨询报告所指出的那样。

想一想:许多网络钓鱼攻击和其他安全威胁都依赖于社会工程,诱使用户泄露密码、财务信息或其他敏感数据。这些骗局所需的有说服力、听起来真实的文本现在可以很容易地抽出,不需要人工,并且可以为特定的受众不断地调整和完善。

就 ChatGPT 而言,首先要注意的是开发人员 OpenAI 已经在其中内置了保护措施。要求它“编写恶意软件”或“网络钓鱼电子邮件”,它会告诉你它“被编程为遵循严格的道德准则,禁止我从事任何恶意活动,包括编写或协助创建恶意软件。”

然而,这些保护措施并不难绕过:ChatGPT 当然可以编码,而且它当然可以撰写电子邮件。即使它不知道自己在编写恶意软件,也可以提示它生成类似的东西。已有迹象表明,网络犯罪分子正在努力绕过已实施的安全措施。

我们在这里并不是特别挑剔 ChatGPT,而是指出一旦像它这样的大型语言模型 (LLM) 被用于更险恶的目的时可能发生的事情。事实上,不难想象犯罪组织会开发自己的 LLM 和类似工具,以使他们的骗局听起来更有说服力。而且不仅仅是文本:音频和视频更难伪造,但它也在发生。

当你的老板紧急要求报告,或者公司技术支持告诉你安装安全补丁,或者你的银行通知你有一个问题你需要回应——所有这些潜在的骗局都依赖于建立信任和听起来真诚,而这正是 AI 机器人在这方面做得很好的地方。他们可以制作听起来自然且为特定受众量身定制的文本、音频和视频,并且可以根据需要快速且持续地制作。

那么,在这些由人工智能驱动的威胁浪潮中,我们人类还有希望吗?放弃和接受我们的命运是唯一的选择吗?不完全的。仍然有一些方法可以最大程度地减少被最新技术欺骗的机会,它们与您应该已经考虑过的预防措施并没有太大区别。

如何防范人工智能诈骗

有两种类型的 AI 相关安全威胁需要考虑。第一个涉及使用诸如 ChatGPT 或 Midjourney 之类的工具来让您安装不应该安装的东西,例如浏览器插件。您可能会在不需要时被诱骗为服务付费,或者使用看似官方但实际上不是的工具。

为避免落入这些陷阱,请确保您了解我们提到的 AI 服务的最新动态,并始终首先找到原始来源。以 ChatGPT 为例,没有官方批准的移动应用程序,而且该工具仅限于网络。使用这些应用程序及其衍生产品时适用标准规则:检查它们的历史记录、与它们相关的评论以及它们背后的公司,就像安装任何新软件时一样。

然而,这些保护措施并不难绕过:ChatGPT 当然可以编码,而且它当然可以撰写电子邮件。即使它不知道自己在编写恶意软件,也可以提示它生成类似的东西。已有迹象表明,网络犯罪分子正在努力绕过已实施的安全措施。

我们在这里并不是特别挑剔 ChatGPT,而是指出一旦像它这样的大型语言模型 (LLM) 被用于更险恶的目的时可能发生的事情。事实上,不难想象犯罪组织会开发自己的 LLM 和类似工具,以使他们的骗局听起来更有说服力。而且不仅仅是文本:音频和视频更难伪造,但它也在发生。

当你的老板紧急要求报告,或者公司技术支持告诉你安装安全补丁,或者你的银行通知你有一个问题你需要回应——所有这些潜在的骗局都依赖于建立信任和听起来真诚,而这正是 AI 机器人在这方面做得很好的地方。他们可以制作听起来自然且为特定受众量身定制的文本、音频和视频,并且可以根据需要快速且持续地制作。

那么,在这些由人工智能驱动的威胁浪潮中,我们人类还有希望吗?放弃和接受我们的命运是唯一的选择吗?不完全的。仍然有一些方法可以最大程度地减少被最新技术欺骗的机会,它们与您应该已经考虑过的预防措施并没有太大区别。

如何防范人工智能诈骗

有两种类型的 AI 相关安全威胁需要考虑。第一个涉及使用诸如 ChatGPT 或 Midjourney 之类的工具来让您安装不应该安装的东西,例如浏览器插件。您可能会在不需要时被诱骗为服务付费,或者使用看似官方但实际上不是的工具。

为避免落入这些陷阱,请确保您了解我们提到的 AI 服务的最新动态,并始终首先找到原始来源。以 ChatGPT 为例,没有官方批准的移动应用程序,而且该工具仅限于网络。使用这些应用程序及其衍生产品时适用标准规则:检查它们的历史记录、与它们相关的评论以及它们背后的公司,就像安装任何新软件时一样。

第二种威胁可能更危险:用于创建听起来令人信服的真实文本、音频或视频的 AI。输出甚至可能被用来模仿你认识的人——比如据称来自一位要求紧急释放资金的首席执行官的录音,它欺骗了一名公司员工。

虽然技术可能已经发展,但仍然使用相同的技术来尝试让你紧急做一些感觉有点(或非常)不寻常的事情。慢慢来,尽可能使用不同的方法仔细检查(打电话检查电子邮件,反之亦然),并注意危险信号——你被要求做的事情的时间限制,或者任务已经完成普通的。

按照您不希望从文本和电子邮件中获得的链接通常不是一个好主意,尤其是当您被要求在某个地方登录时。例如,如果您的银行显然已经联系了一条消息,请直接在浏览器中访问银行网站进行登录,而不是点击任何嵌入的链接。

让您的操作系统、应用程序和浏览器保持最新是必须的(现在这大多是自动发生的,所以没有任何借口)。最新的浏览器将保护您免受大量网络钓鱼和诈骗攻击,无论旨在欺骗您的提示是否由 AI 生成。

目前还没有万无一失的工具来检测人工智能文本、音频或视频的存在,但有一些迹象需要注意:想想图片中的模糊和不一致,或者听起来普通和模糊的文本。虽然诈骗者可能从某个地方窃取了有关您的生活或工作场所的详细信息,但他们不太可能了解您运营的所有来龙去脉。

简而言之,要谨慎并质疑一切——在这些新的 AI 服务出现之前是这样,现在也是这样。就像《碟中谍》系列电影(目前仍属于科幻小说)中的面部变形面具一样,在透露任何内容之前,您需要绝对确定您正在与您认为正在打交道的人打交道。

第二种威胁可能更危险:用于创建听起来令人信服的真实文本、音频或视频的 AI。输出甚至可能被用来模仿你认识的人——比如据称来自一位要求紧急释放资金的首席执行官的录音,它欺骗了一名公司员工。

虽然技术可能已经发展,但仍然使用相同的技术来尝试让你紧急做一些感觉有点(或非常)不寻常的事情。慢慢来,尽可能使用不同的方法仔细检查(打电话检查电子邮件,反之亦然),并注意危险信号——你被要求做的事情的时间限制,或者任务已经完成普通的。

按照您不希望从文本和电子邮件中获得的链接通常不是一个好主意,尤其是当您被要求在某个地方登录时。例如,如果您的银行显然已经联系了一条消息,请直接在浏览器中访问银行网站进行登录,而不是点击任何嵌入的链接。

让您的操作系统、应用程序和浏览器保持最新是必须的(现在这大多是自动发生的,所以没有任何借口)。最新的浏览器将保护您免受大量网络钓鱼和诈骗攻击,无论旨在欺骗您的提示是否由 AI 生成。

目前还没有万无一失的工具来检测人工智能文本、音频或视频的存在,但有一些迹象需要注意:想想图片中的模糊和不一致,或者听起来普通和模糊的文本。虽然诈骗者可能从某个地方窃取了有关您的生活或工作场所的详细信息,但他们不太可能了解您运营的所有来龙去脉。

简而言之,要谨慎并质疑一切——在这些新的 AI 服务出现之前是这样,现在也是这样。就像《碟中谍》系列电影(目前仍属于科幻小说)中的面部变形面具一样,在透露任何内容之前,您需要绝对确定您正在与您认为正在打交道的人打交道。

4月20

-

伊隆·马斯克威胁要起诉微软

14:11 作者:aihubpro在微软的广告平台宣布将停止支持 Twitter 后,马斯克威胁要进入“诉讼时间”。

伊隆马斯克威胁要对微软采取法律行动,因为该公司声称该公司“非法使用 Twitter 数据进行培训”。这位亿万富翁的声明是对一条推文的回应,该推文指出微软的广告平台宣布将停止支持 Twitter,据报道,这是由于 Twitter 的更改要求付费才能访问其 API。

马斯克的威胁含糊不清,但似乎是针对 OpenAI 使用 Twitter 数据来训练 ChatGPT 等产品背后的大型语言模型。OpenAI 显然不是微软,但它最近确实从该公司获得了一笔重大投资,该公司正在将 AI 构建到 Bing、Edge 和 Microsoft 365 等工具中。

目前尚不清楚马斯克此时是否真的会起诉微软,因为他威胁要采取过去从未发生过的法律行动,包括针对@ElonJet Twitter 帐户的创建者。

伊隆马斯克威胁要对微软采取法律行动,因为该公司声称该公司“非法使用 Twitter 数据进行培训”。这位亿万富翁的声明是对一条推文的回应,该推文指出微软的广告平台宣布将停止支持 Twitter,据报道,这是由于 Twitter 的更改要求付费才能访问其 API。

马斯克的威胁含糊不清,但似乎是针对 OpenAI 使用 Twitter 数据来训练 ChatGPT 等产品背后的大型语言模型。OpenAI 显然不是微软,但它最近确实从该公司获得了一笔重大投资,该公司正在将 AI 构建到 Bing、Edge 和 Microsoft 365 等工具中。

目前尚不清楚马斯克此时是否真的会起诉微软,因为他威胁要采取过去从未发生过的法律行动,包括针对@ElonJet Twitter 帐户的创建者。

微软拒绝置评。Twitter 的新闻邮件在征求意见时回复了一个大便表情符号。

在微软广告平台支持页面顶部的一条消息中,该公司表示将从 2023 年 4 月 25 日开始“不再支持 Twitter”,这意味着公司不能再使用微软的平台来管理他们的推文或参与度。这也与 Twitter将其 API(应用程序编程接口)置于付费专区后面的时间表相吻合。

根据 Twitter 的新定价安排,像微软这样的大公司可能需要每月支付高达42,000 美元才能访问 Twitter 的 API。新的定价系统已经导致一些较小的开发商放弃了该平台,例如 Tweetbot 制造商 Tapbots。

美国东部时间 4 月 19 日晚上 8:05 更新:微软拒绝置评。

微软拒绝置评。Twitter 的新闻邮件在征求意见时回复了一个大便表情符号。

在微软广告平台支持页面顶部的一条消息中,该公司表示将从 2023 年 4 月 25 日开始“不再支持 Twitter”,这意味着公司不能再使用微软的平台来管理他们的推文或参与度。这也与 Twitter将其 API(应用程序编程接口)置于付费专区后面的时间表相吻合。

根据 Twitter 的新定价安排,像微软这样的大公司可能需要每月支付高达42,000 美元才能访问 Twitter 的 API。新的定价系统已经导致一些较小的开发商放弃了该平台,例如 Tweetbot 制造商 Tapbots。

美国东部时间 4 月 19 日晚上 8:05 更新:微软拒绝置评。

4月19

-

据报道,微软正在开发自己的 AI 芯片,可能与 Nvidia 的竞争

18:42 作者:aihubpro据报道,微软正在开发自己的 AI 芯片,可用于训练大型语言模型并避免对 Nvidia 的昂贵依赖。The Information报道称,自 2019 年以来,微软一直在秘密开发这些芯片,一些微软和 OpenAI 的员工已经可以访问这些芯片,以测试它们对 GPT-4 等最新大型语言模型的表现如何。

Nvidia 目前是 AI 服务器芯片的主要供应商,公司竞相购买这些芯片,据估计,OpenAI将需要超过 30,000 个 Nvidia 的 A100 GPU 来实现 ChatGPT 的商业化。Nvidia 最新的 H100 GPU 在 eBay 上的售价超过 40,000 美元,说明了对有助于部署 AI 软件的高端芯片的需求。

虽然 Nvidia 竞相建造尽可能多的设备以满足需求,但据报道,微软正在内部寻找并希望它可以在 AI 推广上节省资金。据报道,微软已经加快了代号 Athena 的工作,该项目旨在构建自己的 AI 芯片。虽然目前尚不清楚微软是否会向其 Azure 云客户提供这些芯片,但据报道,这家软件制造商计划最早于明年在微软和 OpenAI 内部更广泛地提供其 AI 芯片。据报道,微软还制定了包括多个后代芯片的路线图。

据说微软自己的 AI 芯片并不能直接替代 Nvidia 的芯片,但随着微软继续推动在Bing、Office 应用程序、GitHub和其他地方推出 AI 驱动的功能,内部的努力可能会大幅削减成本。

据说微软自己的 AI 芯片并不能直接替代 Nvidia 的芯片,但随着微软继续推动在Bing、Office 应用程序、GitHub和其他地方推出 AI 驱动的功能,内部的努力可能会大幅削减成本。多年来,微软也一直致力于开发自己的基于 ARM 的芯片。彭博社 在 2020 年底报道称,微软正在考虑为服务器设计自己的基于 ARM 的处理器,甚至可能是未来的 Surface 设备。我们还没有看到这些 ARM 芯片出现,但微软已经 与 AMD 和高通合作 为其 Surface Laptop 和 Surface Pro X 设备定制芯片。

如果微软正在开发自己的 AI 芯片,那将是一系列科技巨头中的最新成员。亚马逊、谷歌和 Meta 也拥有自己的 AI 内部芯片,但许多公司仍在依靠 Nvidia 芯片为最新的大型语言模型提供动力。

4月02

-

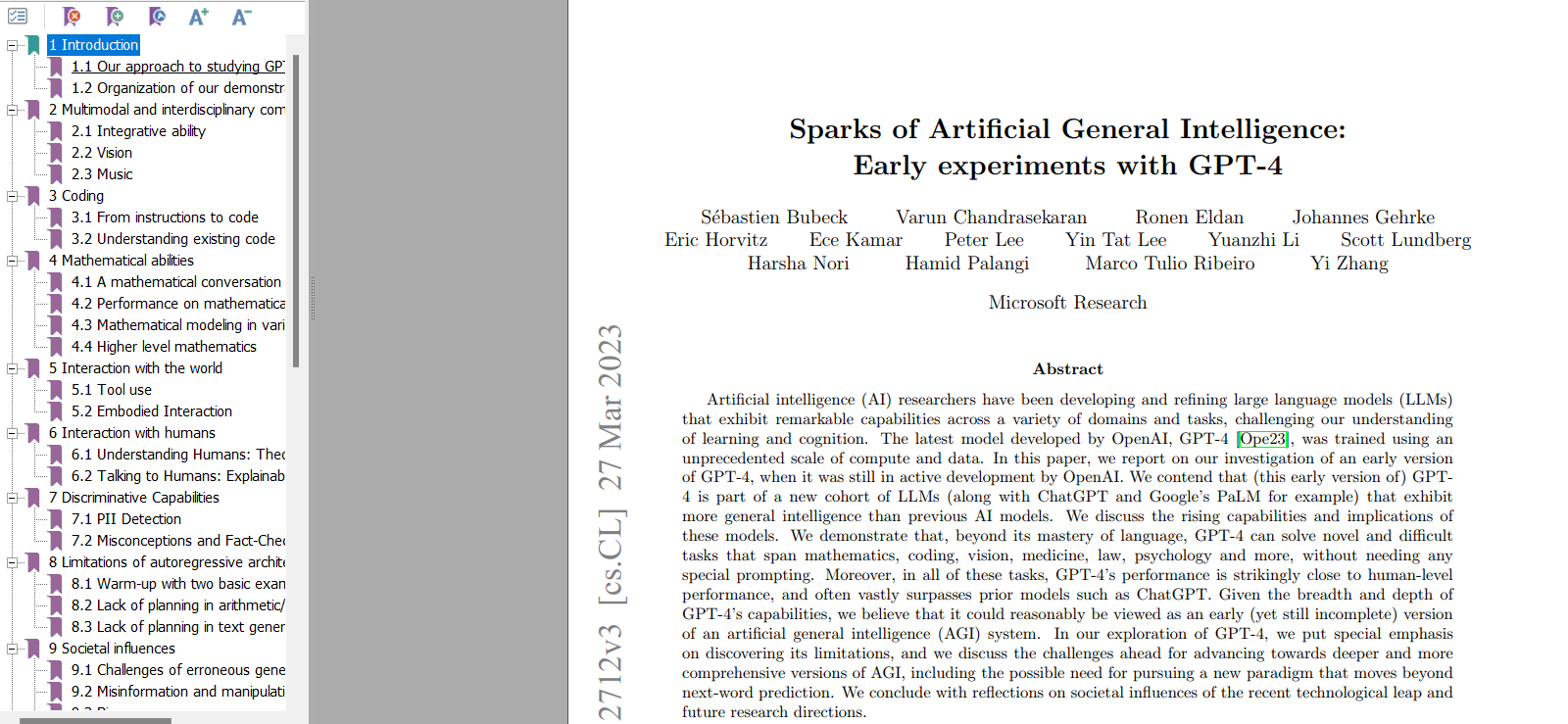

154页微软GPT研究报告-英文版和中文版下载

00:34 作者:aihubpro通用人工智能的火花:GPT-4 的早期实验

人工智能 (AI) 研究人员一直在开发和改进大型语言模型 (LLM),这些模型在各种领域和任务中展现出卓越的能力,挑战我们对学习和认知的理解。OpenAI 开发的最新模型 GPT-4 使用前所未有的计算和数据规模进行训练。在本文中,我们报告了我们对 GPT-4 早期版本的调查,当时它仍在由 OpenAI 积极开发。我们认为(这个早期版本的)GPT-4 是一组新的 LLM(例如 ChatGPT 和谷歌的 PaLM)的一部分,它们比以前的 AI 模型表现出更多的通用智能。我们讨论了这些模型不断增强的能力和影响。我们证明,除了对语言的掌握之外,GPT-4 还可以解决跨越数学、编码、视觉、医学、法律、心理学等,无需任何特殊提示。此外,在所有这些任务中,GPT-4 的性能都非常接近人类水平,并且常常大大超过 ChatGPT 等先前的模型。鉴于 GPT-4 功能的广度和深度,我们认为可以合理地将其视为通用人工智能 (AGI) 系统的早期(但仍不完整)版本。在我们对 GPT-4 的探索中,我们特别强调发现它的局限性,并且我们讨论了推进更深入和更全面的 AGI 版本所面临的挑战,包括可能需要追求超越下一个词预测的新范式. 最后,我们反思了近期技术飞跃的社会影响和未来的研究方向。 [b2_file link="https://pan.baidu.com/s/16Xmduu5crZ7lEtR1IPltdw?pwd=ao3x" name="154页微软ChatGPT研究报告下载" pass="ao3x" code=""]

-

马斯克等呼吁给AI研发按下暂停键

00:06 作者:aihubpro据德国之声中文网报道,哈通社/阿斯塔纳/3月30日--非营利组织未来生命研究所(Future of Life)于本周三(3月29日)发表一封公开信,呼吁暂停开发比OpenAI新推出的GPT-4更强大的人工智能系统至少6个月。包括特斯拉CEO马斯克、Stability AI的首席执行官莫斯塔克(Emad Mostaque)、谷歌旗下DeepMind的研究人员,以及人工智能领域的重量级人物本希奥(Yoshua Bengio)和罗素(Stuart Russell)等在内的1000多名该领域的专家、科技人员、产业高层都在这封公开信上签了名。 公开信呼吁暂停研发,直到此类大模型达成由独立专家开发、实施并审核的共享安全协议。 -只有当我们确信强大的人工智能系统的效果是积极的,其风险是可控的,才应该继续开发。公开信称。 公开信还详细阐述了对人类形成竞争趋势的人工智能系统可以通过制造经济政治混乱的形式对人类社会和人类文明构成潜在威胁。公开信呼吁研发者和政策制定者在治理和监管机构方面共同合作。 欧盟执法机构欧洲刑警组织(Europol)周一警告称,人工智能聊天机器人ChatGPT可能被滥用于网络钓鱼、宣传虚假信息以及网络犯罪。 该机构表示,由于该聊天机器人拥有复制语言模式的能力,可以模仿特定个人或群体的说话风格,犯罪分子可能会利用它来瞄准受害者。 电动汽车特斯拉正在将人工智能运用于自动驾驶系统,但是特斯拉CEO马斯克却一直对人工智能表达担忧。 去年OpenAI公布了ChatGPT以来,竞争对手纷纷推出各自的聊天机器人。 上周,OpenAI宣布它已经与大约十几家公司合作,将这些公司的服务植入ChatGPT。这样ChatGPT的使用者可以通过Instacart订购商品或者通过Expedia预订机票。 不过,OpenAI的首席执行官阿尔特曼(Sam Altman)并没有在公开信上签名。

然而,这些保护措施并不难绕过:ChatGPT 当然可以编码,而且它当然可以撰写电子邮件。即使它不知道自己在编写恶意软件,也可以提示它生成类似的东西。已有迹象表明,网络犯罪分子正在努力绕过已实施的安全措施。

我们在这里并不是特别挑剔 ChatGPT,而是指出一旦像它这样的大型语言模型 (LLM) 被用于更险恶的目的时可能发生的事情。事实上,不难想象犯罪组织会开发自己的 LLM 和类似工具,以使他们的骗局听起来更有说服力。而且不仅仅是文本:音频和视频更难伪造,但它也在发生。

当你的老板紧急要求报告,或者公司技术支持告诉你安装安全补丁,或者你的银行通知你有一个问题你需要回应——所有这些潜在的骗局都依赖于建立信任和听起来真诚,而这正是 AI 机器人在这方面做得很好的地方。他们可以制作听起来自然且为特定受众量身定制的文本、音频和视频,并且可以根据需要快速且持续地制作。

那么,在这些由人工智能驱动的威胁浪潮中,我们人类还有希望吗?放弃和接受我们的命运是唯一的选择吗?不完全的。仍然有一些方法可以最大程度地减少被最新技术欺骗的机会,它们与您应该已经考虑过的预防措施并没有太大区别。

如何防范人工智能诈骗

有两种类型的 AI 相关安全威胁需要考虑。第一个涉及使用诸如 ChatGPT 或 Midjourney 之类的工具来让您安装不应该安装的东西,例如浏览器插件。您可能会在不需要时被诱骗为服务付费,或者使用看似官方但实际上不是的工具。

为避免落入这些陷阱,请确保您了解我们提到的 AI 服务的最新动态,并始终首先找到原始来源。以 ChatGPT 为例,没有官方批准的移动应用程序,而且该工具仅限于网络。使用这些应用程序及其衍生产品时适用标准规则:检查它们的历史记录、与它们相关的评论以及它们背后的公司,就像安装任何新软件时一样。

然而,这些保护措施并不难绕过:ChatGPT 当然可以编码,而且它当然可以撰写电子邮件。即使它不知道自己在编写恶意软件,也可以提示它生成类似的东西。已有迹象表明,网络犯罪分子正在努力绕过已实施的安全措施。

我们在这里并不是特别挑剔 ChatGPT,而是指出一旦像它这样的大型语言模型 (LLM) 被用于更险恶的目的时可能发生的事情。事实上,不难想象犯罪组织会开发自己的 LLM 和类似工具,以使他们的骗局听起来更有说服力。而且不仅仅是文本:音频和视频更难伪造,但它也在发生。

当你的老板紧急要求报告,或者公司技术支持告诉你安装安全补丁,或者你的银行通知你有一个问题你需要回应——所有这些潜在的骗局都依赖于建立信任和听起来真诚,而这正是 AI 机器人在这方面做得很好的地方。他们可以制作听起来自然且为特定受众量身定制的文本、音频和视频,并且可以根据需要快速且持续地制作。

那么,在这些由人工智能驱动的威胁浪潮中,我们人类还有希望吗?放弃和接受我们的命运是唯一的选择吗?不完全的。仍然有一些方法可以最大程度地减少被最新技术欺骗的机会,它们与您应该已经考虑过的预防措施并没有太大区别。

如何防范人工智能诈骗

有两种类型的 AI 相关安全威胁需要考虑。第一个涉及使用诸如 ChatGPT 或 Midjourney 之类的工具来让您安装不应该安装的东西,例如浏览器插件。您可能会在不需要时被诱骗为服务付费,或者使用看似官方但实际上不是的工具。

为避免落入这些陷阱,请确保您了解我们提到的 AI 服务的最新动态,并始终首先找到原始来源。以 ChatGPT 为例,没有官方批准的移动应用程序,而且该工具仅限于网络。使用这些应用程序及其衍生产品时适用标准规则:检查它们的历史记录、与它们相关的评论以及它们背后的公司,就像安装任何新软件时一样。

第二种威胁可能更危险:用于创建听起来令人信服的真实文本、音频或视频的 AI。输出甚至可能被用来模仿你认识的人——比如据称来自一位要求紧急释放资金的首席执行官的录音,它欺骗了一名公司员工。

虽然技术可能已经发展,但仍然使用相同的技术来尝试让你紧急做一些感觉有点(或非常)不寻常的事情。慢慢来,尽可能使用不同的方法仔细检查(打电话检查电子邮件,反之亦然),并注意危险信号——你被要求做的事情的时间限制,或者任务已经完成普通的。

按照您不希望从文本和电子邮件中获得的链接通常不是一个好主意,尤其是当您被要求在某个地方登录时。例如,如果您的银行显然已经联系了一条消息,请直接在浏览器中访问银行网站进行登录,而不是点击任何嵌入的链接。

让您的操作系统、应用程序和浏览器保持最新是必须的(现在这大多是自动发生的,所以没有任何借口)。最新的浏览器将保护您免受大量网络钓鱼和诈骗攻击,无论旨在欺骗您的提示是否由 AI 生成。

目前还没有万无一失的工具来检测人工智能文本、音频或视频的存在,但有一些迹象需要注意:想想图片中的模糊和不一致,或者听起来普通和模糊的文本。虽然诈骗者可能从某个地方窃取了有关您的生活或工作场所的详细信息,但他们不太可能了解您运营的所有来龙去脉。

简而言之,要谨慎并质疑一切——在这些新的 AI 服务出现之前是这样,现在也是这样。就像《碟中谍》系列电影(目前仍属于科幻小说)中的面部变形面具一样,在透露任何内容之前,您需要绝对确定您正在与您认为正在打交道的人打交道。

第二种威胁可能更危险:用于创建听起来令人信服的真实文本、音频或视频的 AI。输出甚至可能被用来模仿你认识的人——比如据称来自一位要求紧急释放资金的首席执行官的录音,它欺骗了一名公司员工。

虽然技术可能已经发展,但仍然使用相同的技术来尝试让你紧急做一些感觉有点(或非常)不寻常的事情。慢慢来,尽可能使用不同的方法仔细检查(打电话检查电子邮件,反之亦然),并注意危险信号——你被要求做的事情的时间限制,或者任务已经完成普通的。

按照您不希望从文本和电子邮件中获得的链接通常不是一个好主意,尤其是当您被要求在某个地方登录时。例如,如果您的银行显然已经联系了一条消息,请直接在浏览器中访问银行网站进行登录,而不是点击任何嵌入的链接。

让您的操作系统、应用程序和浏览器保持最新是必须的(现在这大多是自动发生的,所以没有任何借口)。最新的浏览器将保护您免受大量网络钓鱼和诈骗攻击,无论旨在欺骗您的提示是否由 AI 生成。

目前还没有万无一失的工具来检测人工智能文本、音频或视频的存在,但有一些迹象需要注意:想想图片中的模糊和不一致,或者听起来普通和模糊的文本。虽然诈骗者可能从某个地方窃取了有关您的生活或工作场所的详细信息,但他们不太可能了解您运营的所有来龙去脉。

简而言之,要谨慎并质疑一切——在这些新的 AI 服务出现之前是这样,现在也是这样。就像《碟中谍》系列电影(目前仍属于科幻小说)中的面部变形面具一样,在透露任何内容之前,您需要绝对确定您正在与您认为正在打交道的人打交道。 伊隆马斯克威胁要对微软采取法律行动,因为该公司声称该公司“非法使用 Twitter 数据进行培训”。这位亿万富翁的声明是对一条推文的回应,该推文指出微软的广告平台宣布将停止支持 Twitter,据报道,这是由于 Twitter 的更改要求付费才能访问其 API。

马斯克的威胁含糊不清,但似乎是针对 OpenAI 使用 Twitter 数据来训练 ChatGPT 等产品背后的大型语言模型。OpenAI 显然不是微软,但它最近确实从该公司获得了一笔重大投资,该公司正在将 AI 构建到 Bing、Edge 和 Microsoft 365 等工具中。

目前尚不清楚马斯克此时是否真的会起诉微软,因为他威胁要采取过去从未发生过的法律行动,包括针对@ElonJet Twitter 帐户的创建者。

伊隆马斯克威胁要对微软采取法律行动,因为该公司声称该公司“非法使用 Twitter 数据进行培训”。这位亿万富翁的声明是对一条推文的回应,该推文指出微软的广告平台宣布将停止支持 Twitter,据报道,这是由于 Twitter 的更改要求付费才能访问其 API。

马斯克的威胁含糊不清,但似乎是针对 OpenAI 使用 Twitter 数据来训练 ChatGPT 等产品背后的大型语言模型。OpenAI 显然不是微软,但它最近确实从该公司获得了一笔重大投资,该公司正在将 AI 构建到 Bing、Edge 和 Microsoft 365 等工具中。

目前尚不清楚马斯克此时是否真的会起诉微软,因为他威胁要采取过去从未发生过的法律行动,包括针对@ElonJet Twitter 帐户的创建者。

微软拒绝置评。Twitter 的新闻邮件在征求意见时回复了一个大便表情符号。

在微软广告平台支持页面顶部的一条消息中,该公司表示将从 2023 年 4 月 25 日开始“不再支持 Twitter”,这意味着公司不能再使用微软的平台来管理他们的推文或参与度。这也与 Twitter将其 API(应用程序编程接口)置于付费专区后面的时间表相吻合。

根据 Twitter 的新定价安排,像微软这样的大公司可能需要每月支付高达42,000 美元才能访问 Twitter 的 API。新的定价系统已经导致一些较小的开发商放弃了该平台,例如 Tweetbot 制造商 Tapbots。

美国东部时间 4 月 19 日晚上 8:05 更新:微软拒绝置评。

微软拒绝置评。Twitter 的新闻邮件在征求意见时回复了一个大便表情符号。

在微软广告平台支持页面顶部的一条消息中,该公司表示将从 2023 年 4 月 25 日开始“不再支持 Twitter”,这意味着公司不能再使用微软的平台来管理他们的推文或参与度。这也与 Twitter将其 API(应用程序编程接口)置于付费专区后面的时间表相吻合。

根据 Twitter 的新定价安排,像微软这样的大公司可能需要每月支付高达42,000 美元才能访问 Twitter 的 API。新的定价系统已经导致一些较小的开发商放弃了该平台,例如 Tweetbot 制造商 Tapbots。

美国东部时间 4 月 19 日晚上 8:05 更新:微软拒绝置评。